Il porno di Taylor Swift generato dall’intelligenza artificiale ha invaso X. Ecco come è stata difesa dai fan

Grazie ai miglioramenti dell’intelligenza artificiale, è diventato sempre più semplice creare deepfake con effetti che si sono visti anche nella diffusione della disinformazione online. È quello che è successo in questi giorni, attraverso false immagini sessualmente esplicite e pornografiche di Taylor Swift diffuse su X (ex Twitter). Nello specifico, una di queste, riporta il New York Times, ha ottenuto 47 milioni di visualizzazioni prima che l’account che l’aveva condivisa venisse oscurato dalla moderazione del social. Secondo 404 Media, i deepfake avrebbero origine da un gruppo Telegram in cui gli utenti condividono immagini esplicite di donne generate dall’intelligenza artificiale. Questo episodio potrebbe spingere le istituzioni a porre dei limiti a livello legislativo, come nel caso del disegno di legge della deputata democratica americana Joe Morelle che vorrebbe equiparare a crimine federale la condivisione di questo genere di immagini.

La mossa dei fan della cantante

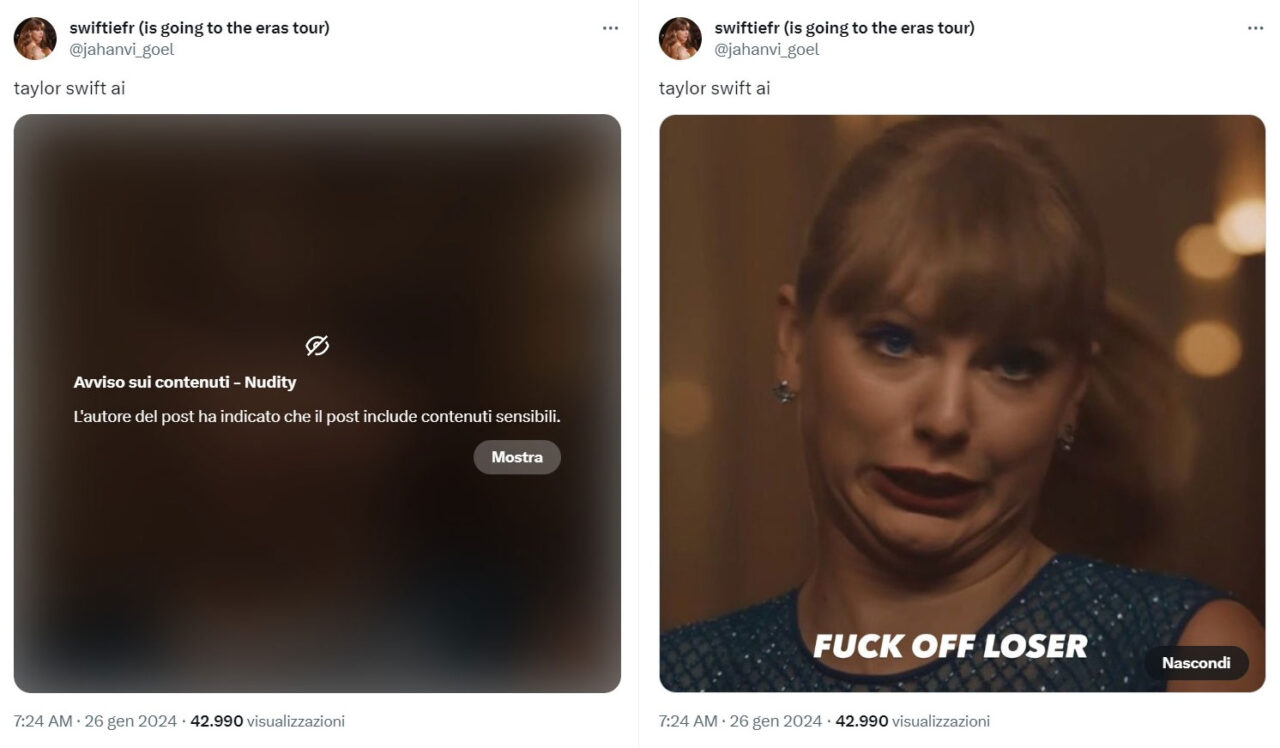

Mentre le immagini generate artificialmente si diffondevano, i fan e le fan dell’artista, persona dell’anno 2023 secondo il Time Magazine, sono accorsi in aiuto della popstar. Inserendo nelle descrizioni dei loro tweet le stesse parole – «Taylor Swift AI» – usate da chi diffonde i contenuti espliciti, hanno riempito la sezione dei risultati con veri video, principalmente tratti da concerti della popstar. In altri casi, le contromisure sono state ancor più ingegnose. Alcuni fan hanno condiviso foto in cui Taylor Swift mostra il dito medio o appare con un’espressione schifata, descrivendole come “Taylor Swift AI”. Segnalandole in massa, X ha iniziato a identificarle erroneamente come materiale sensibile, oscurandole e contribuendo così a preparare un’amara sorpresa a chi si era recato sulla piattaforma alla ricerca dei deepfake. Il movimento ha lanciato un hashtag e un termine di ricerca che per diverse ore è rimasto in tendenza: “#ProtectTaylorSwift”.

La diffusione dei porno deepfake

Sin dal loro arrivo poco più di cinque anni fa, i deepfake sono stati utilizzati, per lo più in maniera non consensuale, per creare immagini e video pornografici di personaggi più o meno famosi. Spesso si limitano a “incollare” il volto della vittima sul corpo di protagonisti di video porno. Tuttavia, a partire dal 2023, i miglioramenti nell’intelligenza artificiale generativa hanno aperto la strada a un aumento esponenziale della presenza di questi contenuti online, come riportato da Wired. Internet si è riempito di piattaforme che consentono di manipolare le foto di individui, in particolare donne, in pochi clic, senza che le vittime siano a conoscenza della manipolazione e della diffusione delle loro immagini. Taylor Swift è solo l’ultimo caso eclatante, ma chiunque, famoso o meno, può essere vittima di questo fenomeno.

Su Open, ad esempio, abbiamo visto il caso della truffa apparentemente pubblicizzata da Elon Musk e Mara Venier e recentemente la stessa Swift è stata oggetto di una finta campagna pubblicitaria di pentole Le Creuset.

Leggi anche:

- Europee 2024, l’Ue punta su Taylor Swift per convincere le nuove generazioni a votare

- Taylor Swift, influencer politica o agente segreto? La pop star nel mirino dei complottisti

- Le Iene, Facchinetti e lo scherzo ad Amadeus: «Ti porto Taylor Swift a Sanremo». Il conduttore ci casca: «È tanta roba» – Il video