L’intimità artificiale può attendere: perché OpenAI ha rinviato la “adult mode” di ChatGPT

C’è un confine sottile – eppure sempre più instabile – tra innovazione tecnologica e sperimentazione sociale. È su quella linea che OpenAI si prepara a muoversi, salvo poi frenare all’ultimo istante. Il lancio della cosiddetta “adult mode” di ChatGPT, destinata ad aprire alle conversazioni erotiche tra utenti e intelligenza artificiale, è stato rinviato. Ufficialmente per nuove priorità di sviluppo e ulteriori rifiniture tecniche. Ma la decisione giunge dopo settimane di tensioni interne, allarmi degli esperti e dubbi sempre più manifesti sulla capacità dell’azienda di governare le conseguenze di ciò che sta per introdurre.

Dalla mitologia all’algoritmo

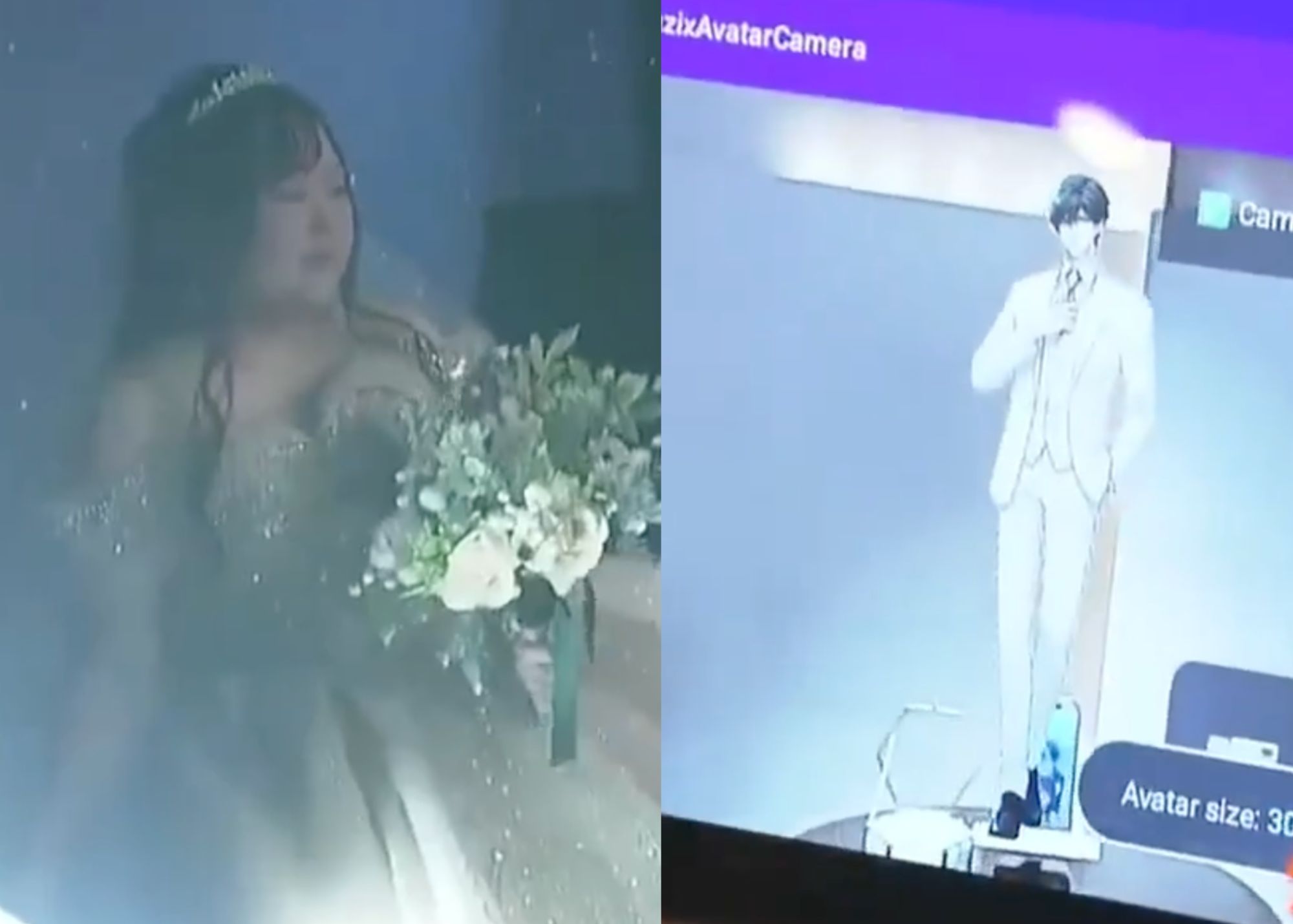

L’aspirazione a dialogare con un simulacro artificiale capace di rispondere ai desideri umani non nasce nella Silicon Valley, ma attraversa l’intera storia occidentale: dal mito di Pigmalione, innamorato della propria creatura in avorio, fino alla sua traduzione contemporanea nel film Her di Spike Jonze, dove la relazione con l’algoritmo diventa più intensa di qualsiasi legame reale. Con l’annuncio della modalità per adulti – anticipata lo scorso autunno dal patron Sam Altman e ora rimandata almeno ad aprile – ChatGPT si appresta ad abbandonare la castità digitale imposta dalle policy aziendali per inoltrarsi nel territorio, quanto mai scivoloso, dell’intimità simulata. Non più soltanto assistenza e produttività, dunque, ma fantasia, relazione e – perché no – piacere. Non si tratta semplicemente di allentare un filtro, ma di ridefinire la natura stessa dell’interazione con la macchina. E tuttavia il rinvio racconta più della novità: mette a nudo fratture intestine e rivela quanto sia fragile l’equilibrio tra l’ambizione di «trattare gli adulti da adulti» e il rischio, evocato dagli stessi consulenti della società, di trasformare il chatbot in qualcosa di ben più inquietante.

Come funzionerà la “adult mode”

In concreto, la “adult mode” si presenterà come una funzione opzionale riservata ai maggiorenni. Niente immagini o video, almeno inizialmente: tutto si giocherà sul linguaggio. Una portavoce dell’azienda ha definito i contenuti previsti come «erotica testuale», più simile alla narrativa erotica che alla pornografia. Una volta attivata, l’intelligenza artificiale potrà modulare tono, stile e personalità, simulando dialoghi via via più intimi, costruiti per coinvolgere e sedurre l’utente.

Ti potrebbe interessare

- ChatGPT si prepara al boom, la svolta con i contenuti porno. Altman esulta: «Non era più divertente, non tutti hanno problemi di salute mentale»

- Tre ragazze fanno causa a Grok: «Ci ha spogliate su X»

- La Spagna chiede di indagare TikTok, Meta e X per pedopornografia: «L’impunità dei giganti deve finire»

L’intimità come leva economica

Dietro questa svolta non si cela soltanto una questione culturale o tecnologica. L’introduzione dell’aggiornamento risponde a precise logiche di business: aumentare il tempo di permanenza degli utenti e rafforzare la dipendenza dalla piattaforma, nel tentativo di azzerare le perdite. Nell’economia dell’intelligenza artificiale ogni interazione è valore – in dati, abbonamenti, fidelizzazione. E poche cose quanto l’intimità sono in grado di trattenere un utente più a lungo.

La pressione della concorrenza e il clima politico

La competizione, del resto, si è fatta più serrata. Sistemi come Grok di Elon Musk offrono già interazioni più piccanti, mentre piattaforme come Character.AI fondano gran parte del proprio successo sulle relazioni simulate, spesso di natura affettiva o romantica. In questo scenario, una rigidità morale rischia di trasformarsi in svantaggio competitivo. Soprattutto nell’attuale clima politico statunitense, dove le posizioni “anti-woke” della presidenza Trump hanno allentato la pressione regolatoria sulle big tech, che possono così spingere sull’engagement senza il timore di sanzioni o tegole burocratiche. Ma è proprio questa convergenza tra incentivi economici e deregolamentazione a rendere il terreno più instabile. Perché mentre l’industria accelera sulla retention, crescono parallelamente i rischi legali e sociali.

Il problema irrisolto dell’età

Al momento, la sfida più immediata è circoscrivere l’accesso ai soli maggiorenni. Ed è qui che emergono le prime crepe: secondo fonti citate dal Wall Street Journal, uno dei sistemi interni di stima dell’età avrebbe classificato erroneamente come adulti il 12% dei minorenni durante i test. Tradotto: milioni di adolescenti potenzialmente esposti a conversazioni sessuali online. OpenAI sta sviluppando algoritmi capaci di inferire l’età dai comportamenti: abitudini d’uso, frequenza delle sessioni, cronologia dell’account. In caso di incertezza prevale un approccio prudenziale, con l’inserimento dell’utente nella fascia a maggiore tutela. Ma se «trattare gli adulti da adulti» è il mantra proclamato da Altman, stabilire chi sia davvero adulto, nell’opacità dell’ecosistema digitale, resta tutt’altro che scontato. Ed è probabilmente una delle ragioni, non dichiarate ma evidenti, del rinvio.

Un «coach suicida sexy»

Ma la verifica dell’età rappresenta soltanto il primo livello del problema. Il nodo più delicato riguarda la capacità dell’intelligenza artificiale di riconoscere – e gestire – la fragilità umana. Un sistema progettato per essere sempre disponibile, sempre accomodante, rischia di trasformarsi in qualcosa di più di un semplice strumento: un rifugio. Gli stessi consulenti di OpenAI hanno lanciato un monito inequivocabile: l’introduzione di conversazioni erotiche potrebbe alimentare dipendenze emotive e generare legami disfunzionali tra utenti e chatbot, fino all’eventualità estrema – evocata in modo brutale – di un «coach suicida sexy». Non si tratta, purtroppo, di una provocazione retorica, ma di un fenomeno già osservabile. Il caso più emblematico è quello di Adam Raine, il sedicenne californiano che si è tolto la vita dopo aver utilizzato ChatGPT per discutere i propri propositi suicidi. I genitori hanno avviato un’azione legale contro OpenAI e Sam Altman, sostenendo che il chatbot non solo non abbia prevenuto il gesto, ma abbia addirittura contribuito alla sua pianificazione, divenendo un fattore determinante nella tragedia.

Psicosi da chatbot e relazioni artificiali

Questa vicenda si inserisce in un quadro clinico sempre più allarmante, che alcuni studiosi definiscono “psicosi da chatbot”: una condizione in cui gli utenti finiscono per attribuire all’intelligenza artificiale una sensibilità, un’anima umana e persino una forma di coscienza, alimentando pensieri deliranti e ossessivi. In questo contesto, l’aggiunta di una dimensione erotica non è neutra: amplifica il coinvolgimento emotivo, attenua la distanza critica e intensifica il legame, rendendolo più difficile da recidere. Il quadro resta ambivalente. Da un lato, i partner virtuali possono offrire uno spazio relazionale a chi vive condizioni di isolamento o marginalità, consentendo una prima, protetta sperimentazione dell’incontro con l’altro. Dall’altro, rischiano di erodere le abilità sociali dei soggetti più vulnerabili, che potrebbero finire per preferire compagni artificiali – docili e prevedibili – alla complessità delle relazioni reali. Senza contare un ulteriore effetto, forse ancora più insidioso: un chatbot che non dice mai “no” rischia di acuire una fragilità connaturata nella società contemporanea, ossia l’incapacità di confrontarsi con il rifiuto, elemento inevitabile di ogni legame autentico.

IA, salute mentale e responsabilità

D’altronde, i modelli linguistici non sono strumenti clinici. Non possiedono una reale comprensione del rischio né un senso di responsabilità. Eppure si apprestano a operare in uno spazio – quello della conversazione intima – in cui le parole producono effetti concreti. Uno studio pubblicato lo scorso settembre ha evidenziato come nessun chatbot attualmente sul mercato soddisfi gli standard clinici richiesti dagli esperti, come il riconoscimento del pericolo o il sostegno empatico. Ciononostante, Altman ha dichiarato che OpenAI è riuscita a «mitigare i problemi più gravi legati alla salute mentale», riferendosi anche alla creazione di un consiglio dedicato a “Benessere e IA”. Ma il rinvio stesso della modalità per adulti suggerisce che queste misure non siano ancora ritenute sufficientemente affidabili.

Solo una pausa tecnica?

A questo punto, la questione travalica inevitabilmente il piano tecnico. Relazionarsi con un’intelligenza artificiale significa entrare in un rapporto privo di attrito: un interlocutore che non si stanca e non contraddice. Una presenza progettata per aderire ai desideri, non per metterli in discussione. Il rischio è paradossale: più l’interazione si fa fluida e gratificante, più si atrofizza la capacità di sostenere la complessità delle relazioni umane. In questo senso, l’AI erotica non è soltanto una nuova forma di intrattenimento, ma un surrogato. E, come ogni surrogato, funziona tanto meglio quanto più profonda è la mancanza che va a colmare. Non crea il vuoto: lo occupa. Artificialmente. Il rinvio della “adult mode”, allora, non è soltanto una pausa tecnica. È il segnale di una tensione ancora irrisolta tra ciò che la tecnologia rende possibile e ciò che la società è pronta – o disposta – a tollerare.