Questi non sono veri servizi dei TG: sono generati con l’AI

Negli ultimi giorni tre video presentati come servizi di telegiornale stanno circolando su Facebook, ottenendo visualizzazioni e commenti indignati. Mostrano presunte “breaking news” su decisioni del governo, casi di cronaca giudiziaria e vicende di legittima difesa finite male. Tutti e tre i filmati provengono dallo stesso account, noto per diffondere video creati con l’intelligenza artificiale senza dichiararlo. Dietro la narrazione allarmistica e il finto stile giornalistico infatti si cela l’intelligenza artificiale.

Per chi ha fretta:

- I tre video non mostrano servizi televisivi reali: sono stati generati con l’AI.

- Provengono dallo stesso account Facebook, che pubblica “ricostruzioni” fittizie spesso senza segnalare l’uso di AI.

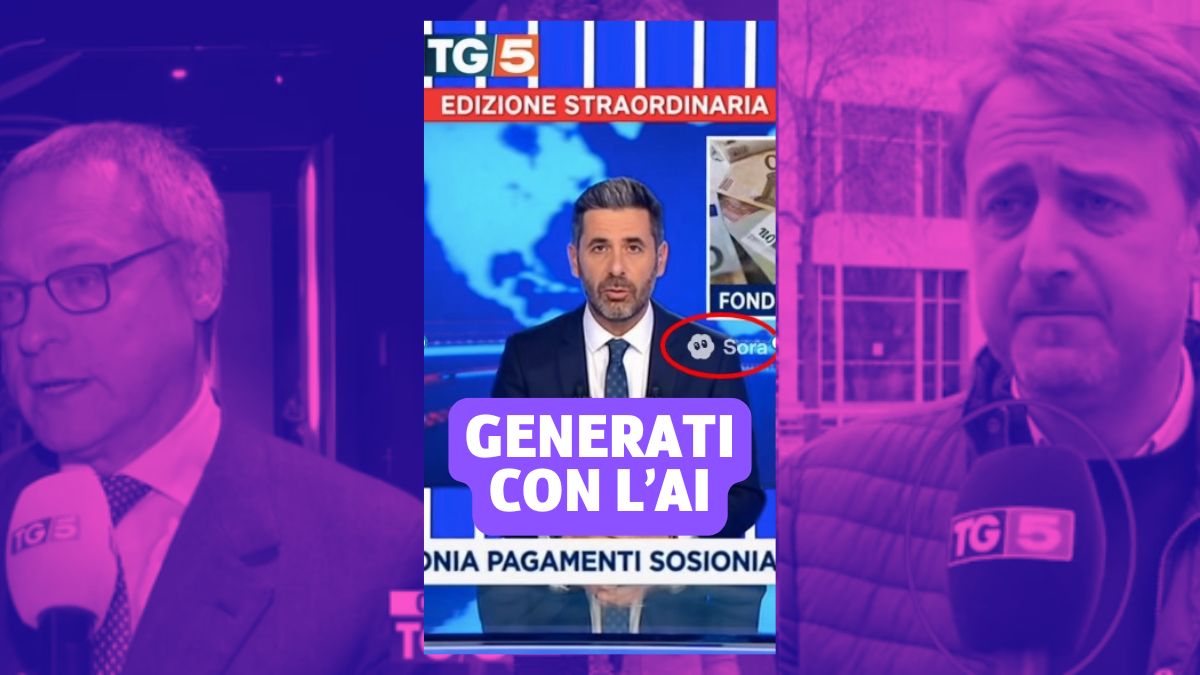

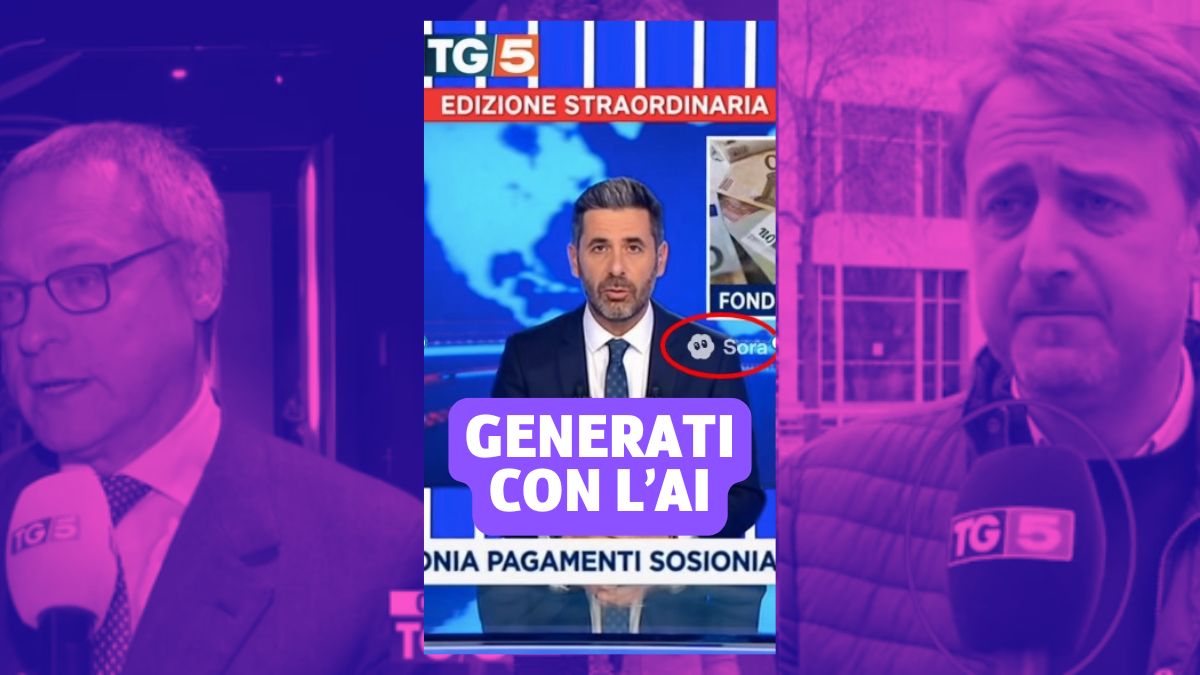

- Nessun governo ha sospeso le pensioni; il servizio TG5 è falso, con watermark Sora, loghi errati e testo distorto.

- La storia del vigilante “Ruggeri” condannato a risarcire i rapinatori non esiste; nessun caso reale corrisponde ai dettagli del video.

- Inesistente anche l’uomo condannato per aver “ecceduto” difendendosi da tre “slavi”; volti e testo rivelano l‘utilizzo di AI.

Analisi

Tutti e tre i video sono stati pubblicati dallo stesso profilo Facebook, che si autodefinisce “Diffusore di video per boomer incazzati. Video divertenti e ricostruzioni di fatti realmente accaduti”, salvo includere il tag “AI” solo raramente. L’account miscela toni sensazionalistici e grafica pseudo-giornalistica spacciando contenuti artificiali per servizi TV reali. I tre video infatti riportano storie false mirando a suscitare indignazione su temi già polarizzanti.

Il finto TG5 che annuncia la sospensione delle pensioni

Il primo video simula una “breaking news” del TG5, sostenendo che il governo avrebbe annunciato “la sospensione immediata di tutte le pensioni”. La notizia è completamente inventata: non esistono comunicati, decreti o dichiarazioni istituzionali al riguardo. Inoltre diversi indizi tecnici confermano la falsificazione. Primo fra tutti è il watermark di Sora, uno dei principali generatori video Ai, visibile in diversi punti dello schermo.

Inoltre, il logo del TG5 non coincide con quello reale: colori, proporzioni e font sono sbagliati.

Infine, la banda testuale contiene parole deformate e con lettere errate, un tratto ricorrente nei video AI, incapaci di riprodurre correttamente scritte nitide e lineari.

Il vigilante inesistente condannato a risarcire i rapinatori

Il secondo video, viene presentato come una “scena ricostruita di fatti realmente accaduti”. Racconta di un vigilante di sicurezza, il “sig. Ruggeri”, che avrebbe aperto il fuoco durante una rapina per difendere i clienti, venendo poi condannato a tre anni e al risarcimento dei rapinatori. La storia è completamente fabbricata: non esiste infatti alcuna storia che tratti di un vigilante Ruggeri condannato. La sceneggiatura potrebbe aver preso ispirazione da due casi: quello di Stefano Salmoni che nel 2019 è stato condannato a 2 anni per aver ucciso un rapinatore in fuga; e quello di Antonio Micarelli che nel 2025 è stato arrestato per omicidio volontario, il cui caso è ancora in corso. Inoltre, la grafica utilizzata per il servizio televisivo del fittizio “TG5” sottolinea la natura artificiale del video: il microfono utilizzato infatti riporta un logo simile ma non identico a quello del TG5, e il colore è blu anziché grigio. Infine, il volto dell’intervistato è eccessivamente levigato, con tratti sintetici tipici dell’AI.

La condanna per aver eccesso di difesa personale

Il terzo video racconta di un uomo sarebbe stato condannato a risarcire tre “slavi” che avrebbero tentato di rapinarlo. Il giudice, secondo il video, avrebbe stabilito un risarcimento di 29.000 euro perché il protagonista avrebbe “ecceduto” nella legittima difesa. Anche in questo caso la storia non esiste. Anche in questo caso gli elementi visivi tradiscono la generazione artificiale: le scritte della banda inferiore sono distorte e contengono errori ortografici, tipici dei modelli video AI, mentre i volti appaiono quasi plastificati, con texture irrealistiche.

Conclusioni

I tre video analizzati non documentano fatti reali, ma sono contenuti generati con l’intelligenza artificiale e presentati in stile giornalistico per renderli credibili. Nessuna delle vicende è supportata da fonti affidabili, e l’account che li diffonde è noto per diffondere notizie false e video fabbricati artificialmente.

Questo articolo contribuisce a un progetto di Meta per combattere le notizie false e la disinformazione nelle sue piattaforme social. Leggi qui per maggiori informazioni sulla nostra partnership con Meta