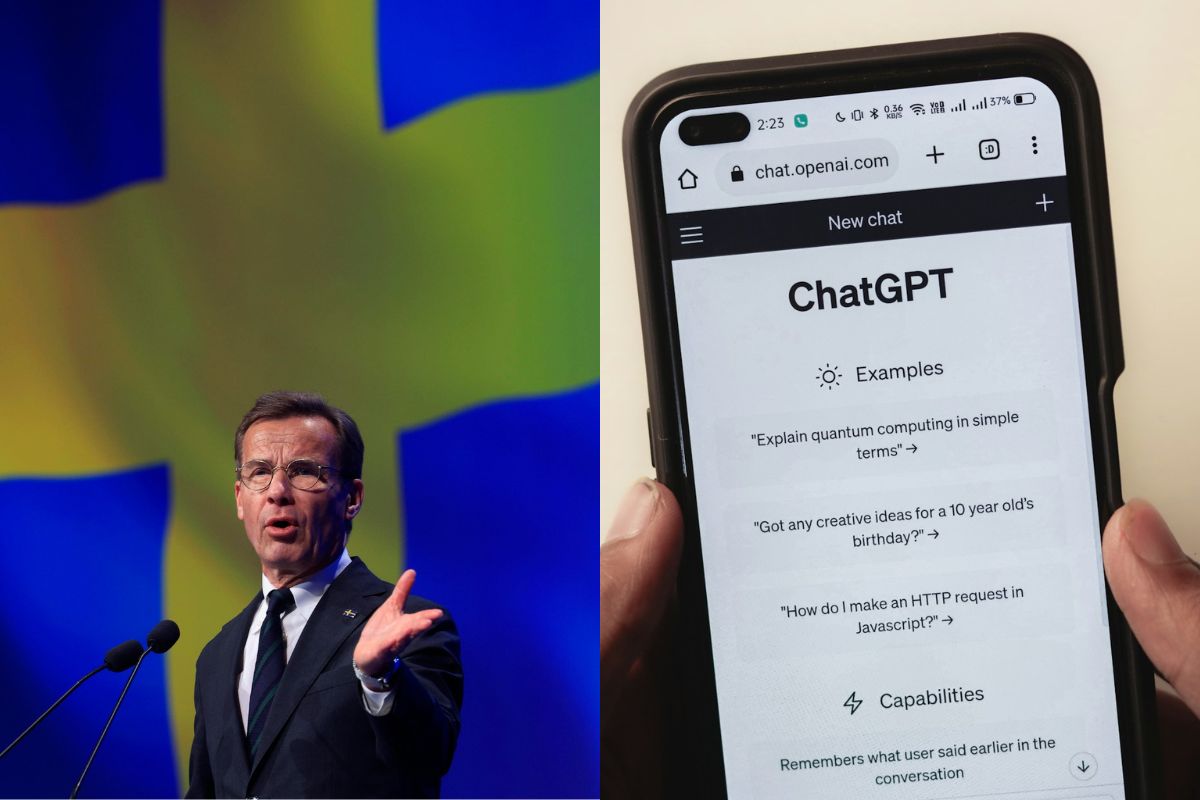

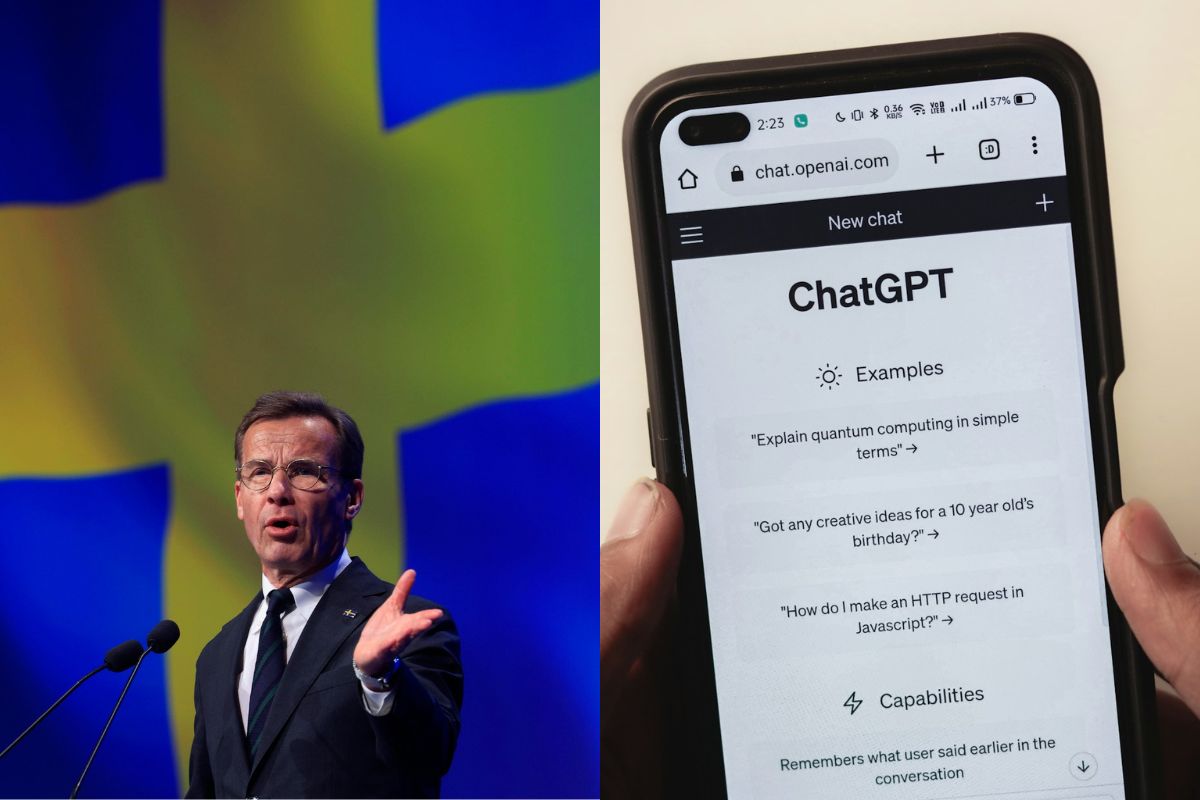

Il premier svedese ammette di chiedere opinioni all’intelligenza artificiale, scoppia la polemica: «Non abbiamo votato ChatGPT»

È polemica in Svezia dopo le dichiarazioni del primo ministro Ulf Kristersson che ha ammesso di utilizzare regolarmente strumenti di intelligenza artificiale, tra cui ChatGPT e LeChat, per ricevere «una seconda opinione» nel suo lavoro alla guida del paese. Come riporta il Guardian, questa rivelazione ha acceso il dibattito tra gli elettori svedesi. «Lo uso abbastanza spesso. Se non altro per avere un punto di vista alternativo: cosa hanno fatto gli altri? Dovremmo forse pensare l’esatto contrario?», ha dichiarato Kristersson, leader del partito Moderato e figura centrale della coalizione di centrodestra che governa la Svezia.

Gli avvertimenti degli esperti

Ma la trasparenza del premier non è stata accolta di buon grado. Diverse voci della stampa locale hanno accusato Kristersson di essere «caduto nella psicosi dell’IA degli oligarchi», e critici sono stati anche gli esperti del mondo tech. Una delle principali preoccupazioni riguarda la possibile fuga di materiale strettamente confidenziale, che il premier potrebbe involontariamente aver fornito ai modelli di intelligenza artificiale. È di pochi giorni fa, infatti, la notizia che migliaia di conversazioni intrattenute con ChatGPT siano state rese pubbliche e liberamente consultabili su Google, una falla nel sistema della privacy che spaventa gli utenti. Simone Fischer-Hübner, docente di informatica all’università di Karlstad, ha messo in guardia sull’uso delle AI come ChatGPT in ambito governativo: «Bisogna essere molto cauti, soprattutto per quanto riguarda dati sensibili».

Chi prende le decisioni nel governo svedese?

Ma a tal proposito il portavoce del premier, Tom Samuelsson, ha provato a chiarire, specificando che Kristersson non condivide informazioni riservate e che l’intelligenza artificiale è utilizzata come una sorta di super consigliere al quale rivolgersi per curiosità. Ma per Virginia Dignum, docente di Intelligenza Artificiale responsabile all’università di Umeå, il problema è più profondo e non riguarda solo la sicurezza dei dati, ma i principi di funzionamento della democrazia. «L’IA non può fornire opinioni significative su idee politiche, riflette semplicemente i valori di chi l’ha progettata», ha detto al Dagens Nyheter. «Più ci si affida all’IA per questioni semplici, maggiore è il rischio di sviluppare una fiducia eccessiva nel sistema. È un terreno scivoloso. Noi non abbiamo votato per ChatGPT».

Foto di copertina: EPA/Kai Foersterling | Sanket Mishra su Unsplash