Grok e la strage in Iran: perché l’IA di Musk ha fallito il fact-check sulla scuola di Minab

L’intelligenza artificiale di X, Grok, è diventata la principale fonte di disinformazione sul bombardamento della scuola di Minab, in Iran. Secondo l’algoritmo di Elon Musk, noto per la sua inaffidabilità, i video del disastro sarebbero “vecchie immagini di Kabul 2021”. Ma si tratta di un errore colossale in quanto le immagini sono attuali e geolocalizzate, smentite soprattutto dal confronto con le vere immagini del fatto avvenuto a Kabul nel 2021.

Per chi ha fretta

- Molti utenti negano il bombardamento alla scuola iraniana citando come prova una risposta di Grok.

- L’IA sostiene che i filmati risalgano all’attentato di Kabul del maggio 2021.

- L’analisi OSINT smentisce l’Intelligenza Artificiale di Elon Musk: le architetture confermano che il video è stato girato in Iran.

- Le immagini dei fatti avvenuti nel 2021 a Kabul, in Afghanistan, mostrano edifici completamente differenti.

L’incompetenza di Grok al servizio del negazionismo

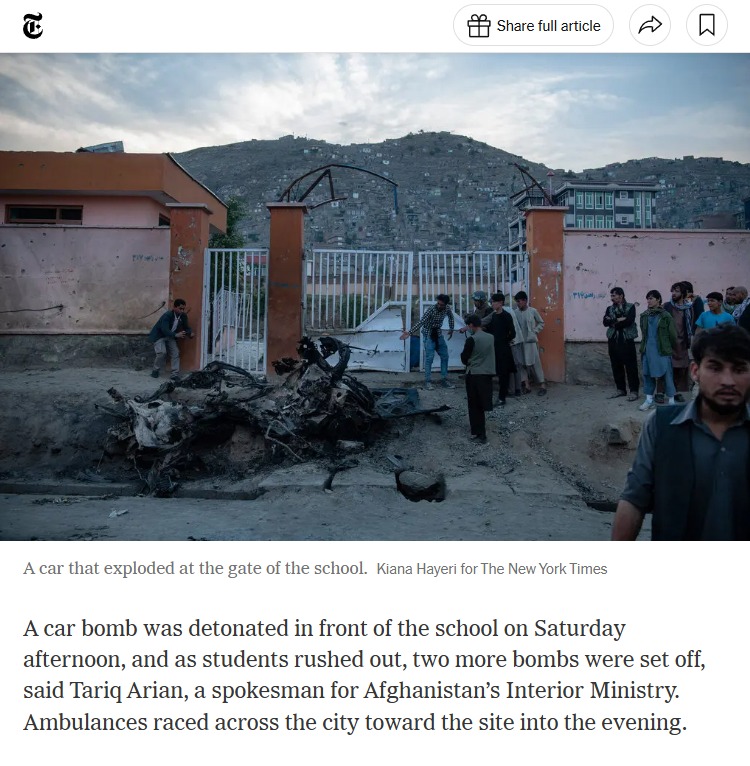

Il caso è l’ennesima dimostrazione di come l’intelligenza artificiale di Elon Musk diventa un’arma di disinformazione di massa. Interrogata sui video della scuola di Minab (148 vittime), Grok ha risposto con estrema sicurezza: «Sì, il video è dell’attentato dell’8 maggio 2021 nella scuola Sayed ul-Shuhada di Kabul». Fonti? Grok cita il New York Times, The Guardian, Al Jazeera e Wikipedia che, come vedremo a breve, smentiscono la stessa AI.

La risposta di Grok è tecnicamente falsa. L’AI ha compiuto quella che in gergo si chiama “allucinazione”. In cosa consiste? Non avendo capacità di analisi video, ha pescato nel suo database qualsiasi informazione utile, anche se sbagliata.

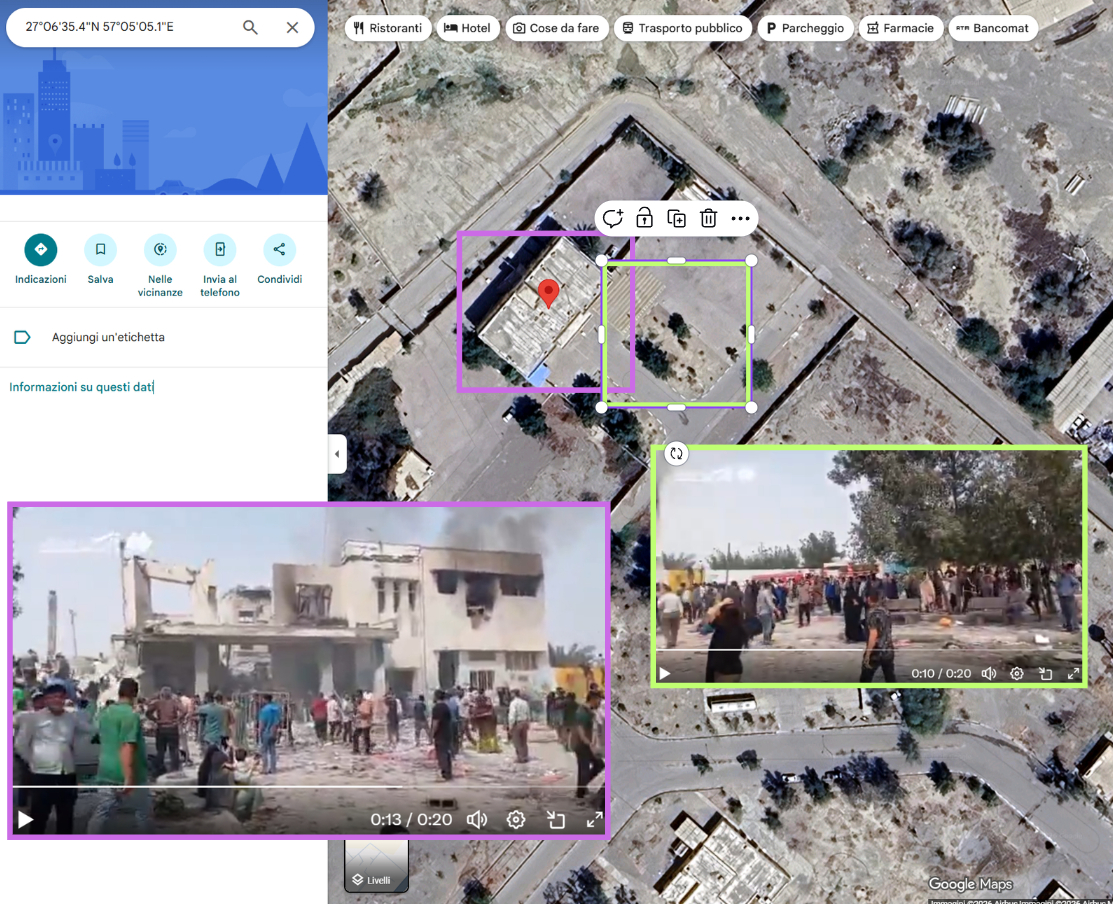

La prova della geolocalizzazione

Nonostante le certezze di Grok, i dati geografici sono inoppugnabili. La scuola colpita in Iran, la Shajareh Tayyebeh, si trova alle coordinate 27°06’35.4″N 57°05’05.1″E.

Confrontando i video attuali con i filmati di Kabul 2021, emergono differenze strutturali che l’AI di Grok, come in passato, non è in grado di comprendere e apprendere. Nelle sue risposte agli utenti, fornisce come fonte un articolo del New York Times del maggio 2021, ma le immagini contenute in quest’ultimo la smentiscono.

Conclusioni

Fidarsi di Grok per verificare una notizia è un errore metodologico, come spiegato in passato dai nostri precedenti fact-check. L’IA di X ha dimostrato di non saper distinguere tra l’Iran del 2026 e l’Afghanistan del 2021, trasformando una tragedia reale in una “fake news” a causa dei suoi forti limiti.