Il video fake della soldatessa IDF che calpesta una donna palestinese e il trucco usato dalla propaganda

Circola il video di una soldatessa dell’IDF bionda che calpesta una donna palestinese a terra tra le risate dei presenti. La clip è in realtà un falso creato con l’Intelligenza Artificiale Gemini di Google. Analizzando i fotogrammi, emergono errori strutturali e la prova della manipolazione di un vecchio video di TikTok del 2023.

Per chi ha fretta

- Il video non è reale, in quanto creato artificialmente partendo da un’altra clip.

- La base originale è un video TikTok del 2023 in cui la soldatessa balla con una collega.

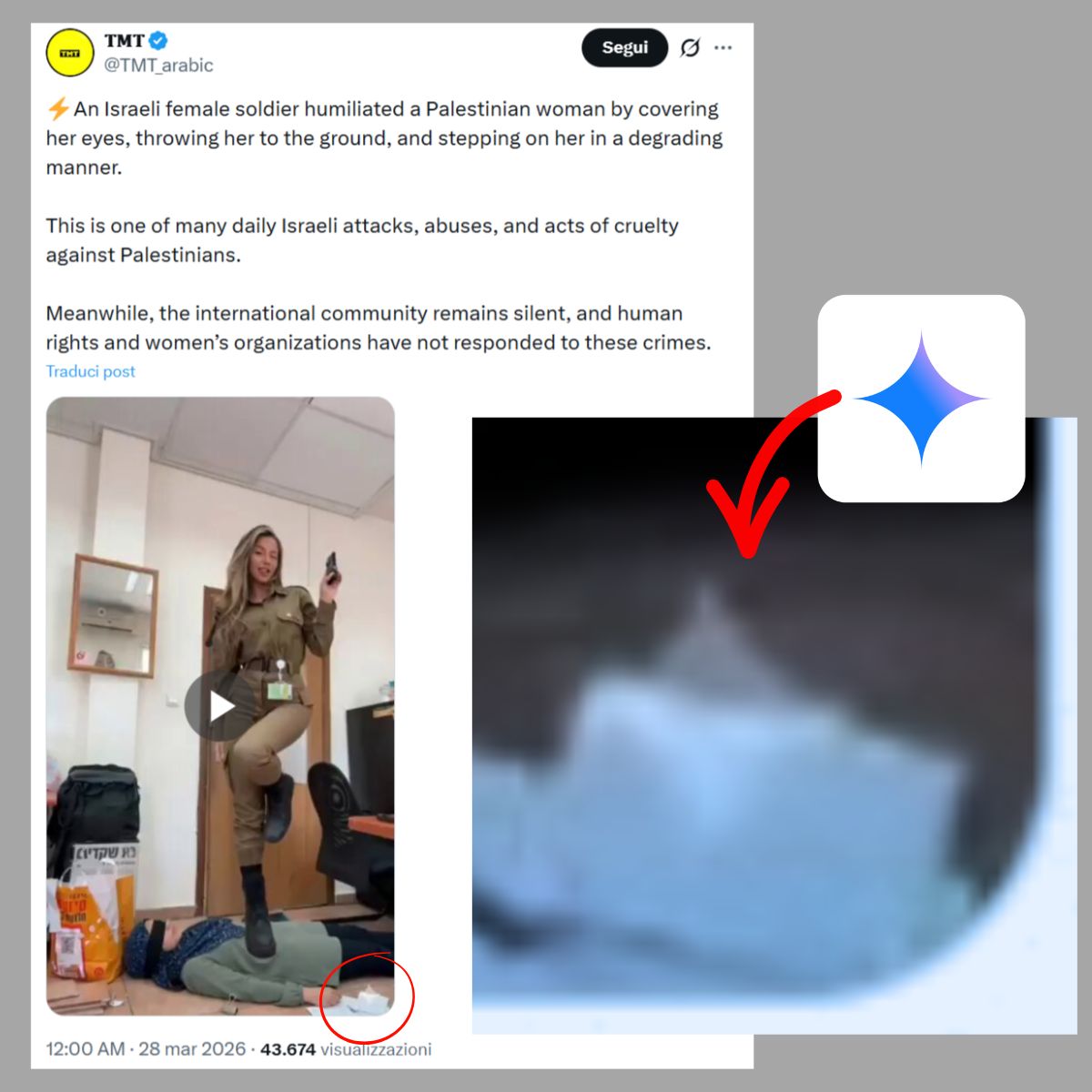

- Il video falso presenta il logo di Gemini in basso a destra.

- L’intelligenza artificiale ha “allucinato” dettagli come sedie incomplete e porte prive di pannelli.

- Il watermark di sicurezza SynthID è stato raggirato registrando il video falso da uno schermo.

Analisi

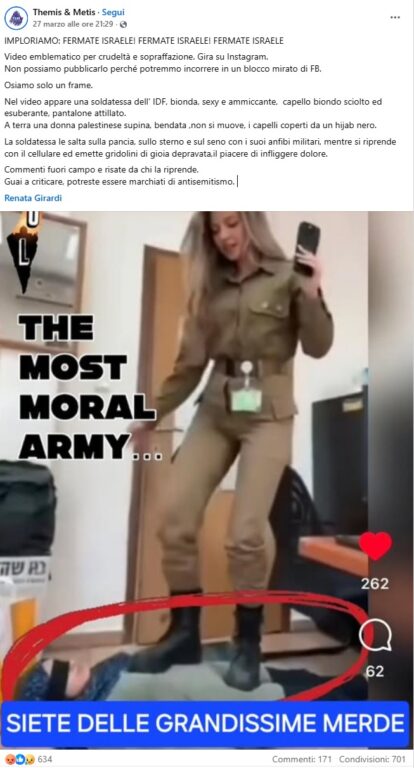

Nella descrizione del video che circola online si legge: «Nel video appare una soldatessa dell’IDF, bionda e sexy, che salta sulla pancia e sul seno di una donna palestinese supina e bendata, emettendo gridolini di gioia depravata». La clip suggerisce un piacere sadico nell’infliggere dolore, ammonendo gli utenti a non criticare per non essere marchiati di antisemitismo.

I primi dubbi sul video

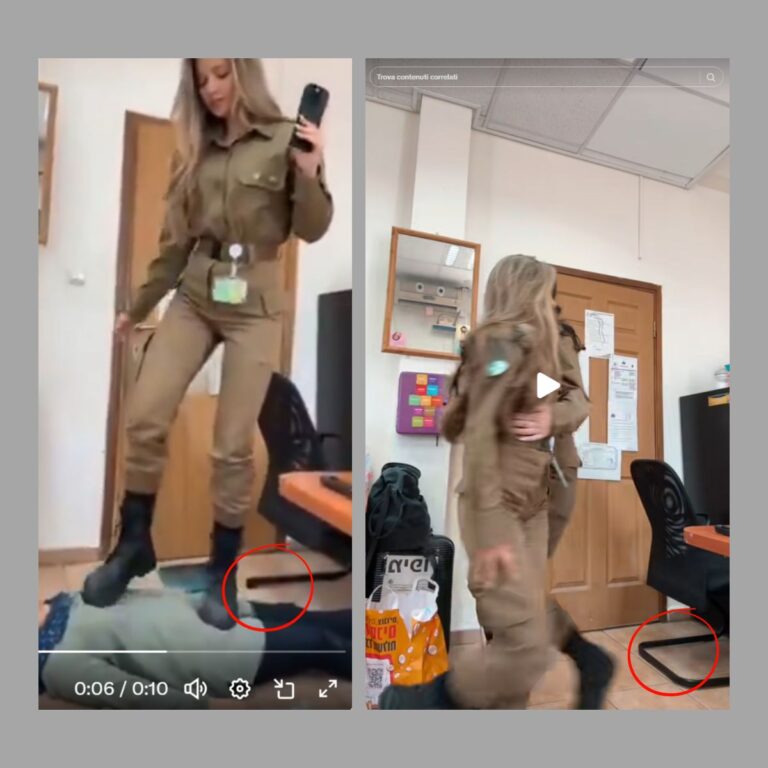

Un’analisi attenta del video rivela che la scena è fisicamente impossibile. Ad esempio, la soldatessa appare in un equilibrio troppo perfetto mentre calpesta il corpo. Inoltre, la vittima a terra rimane immobile, non reagendo minimamente ai colpi ricevuti nonostante si sentano lamenti ad alta voce fuori campo.

Il logo di Gemini presente nel video fake

Nello screenshot condiviso in Italia, mostra una scritta in grande su sfondo blu («Siete delle grandissime merde») che però copre un elemento fondamentale per la verifica: il logo di Gemini.

Nel video che circola online, dove la soldatessa viene mostrata mentre calpesta la donna palestinese, il logo compare e scompare, ma spiegheremo dopo il perché.

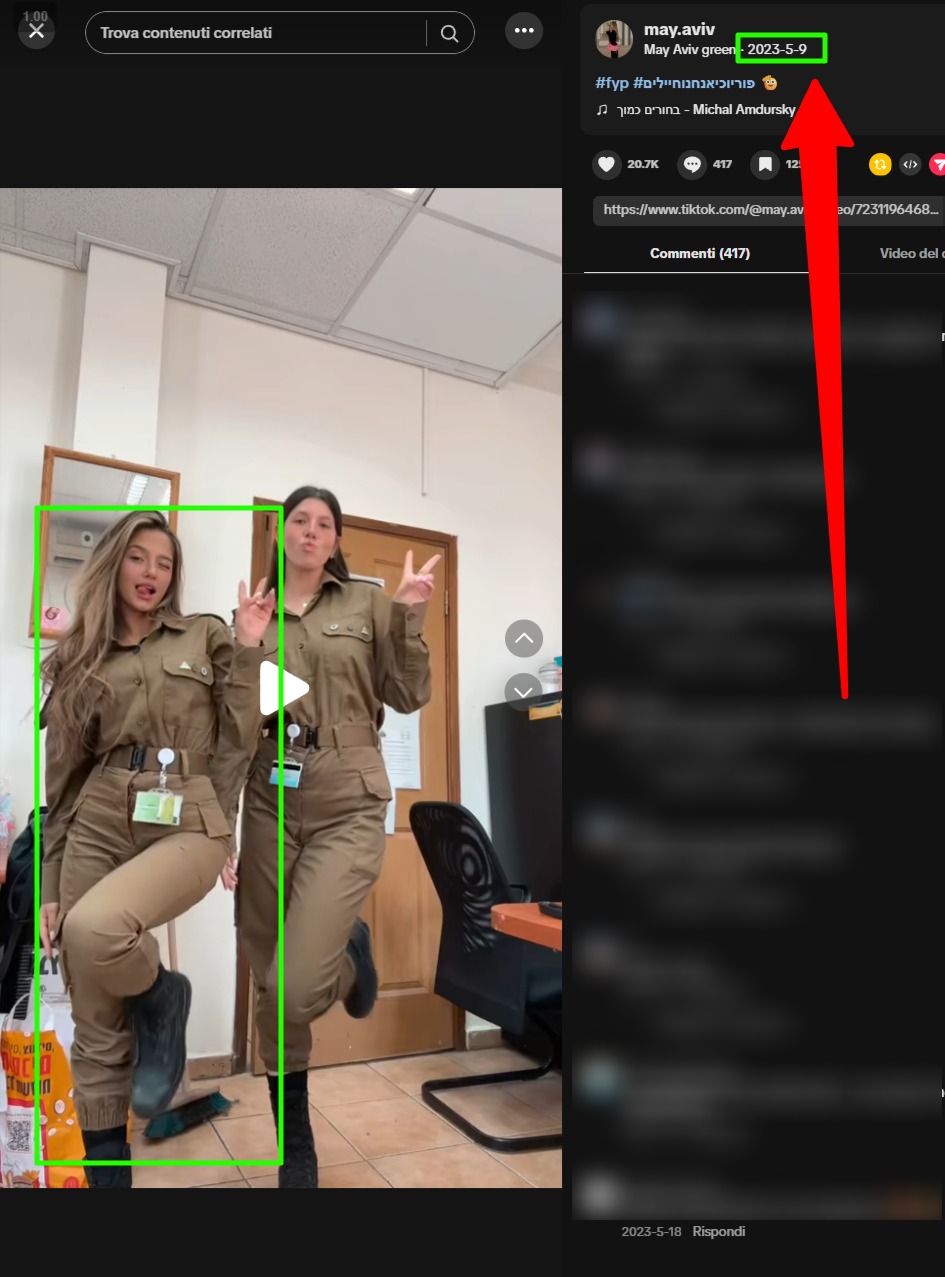

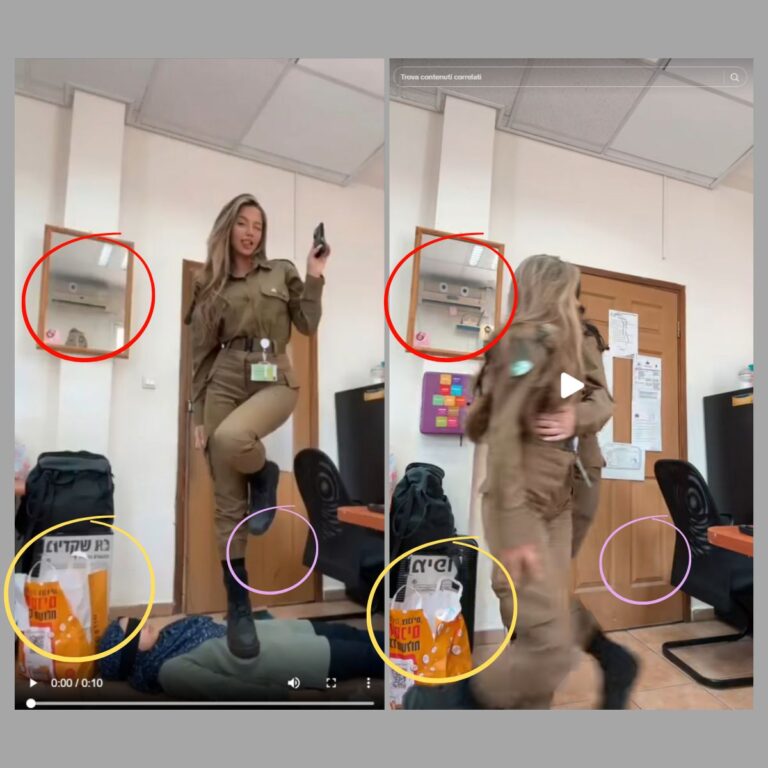

La fonte originale: un video TikTok del 2023

Attraverso una ricerca inversa, è possibile risalire al video originale utilizzato come base per generare quello falso attraverso l’uso di Gemini. Si tratta di un video pubblicato nel 2023 sul canale TikTok @may.aviv della soldatessa. Nel filmato vero non c’è alcuna violenza. Infatti, la giovane sta semplicemente ballando insieme a una collega.

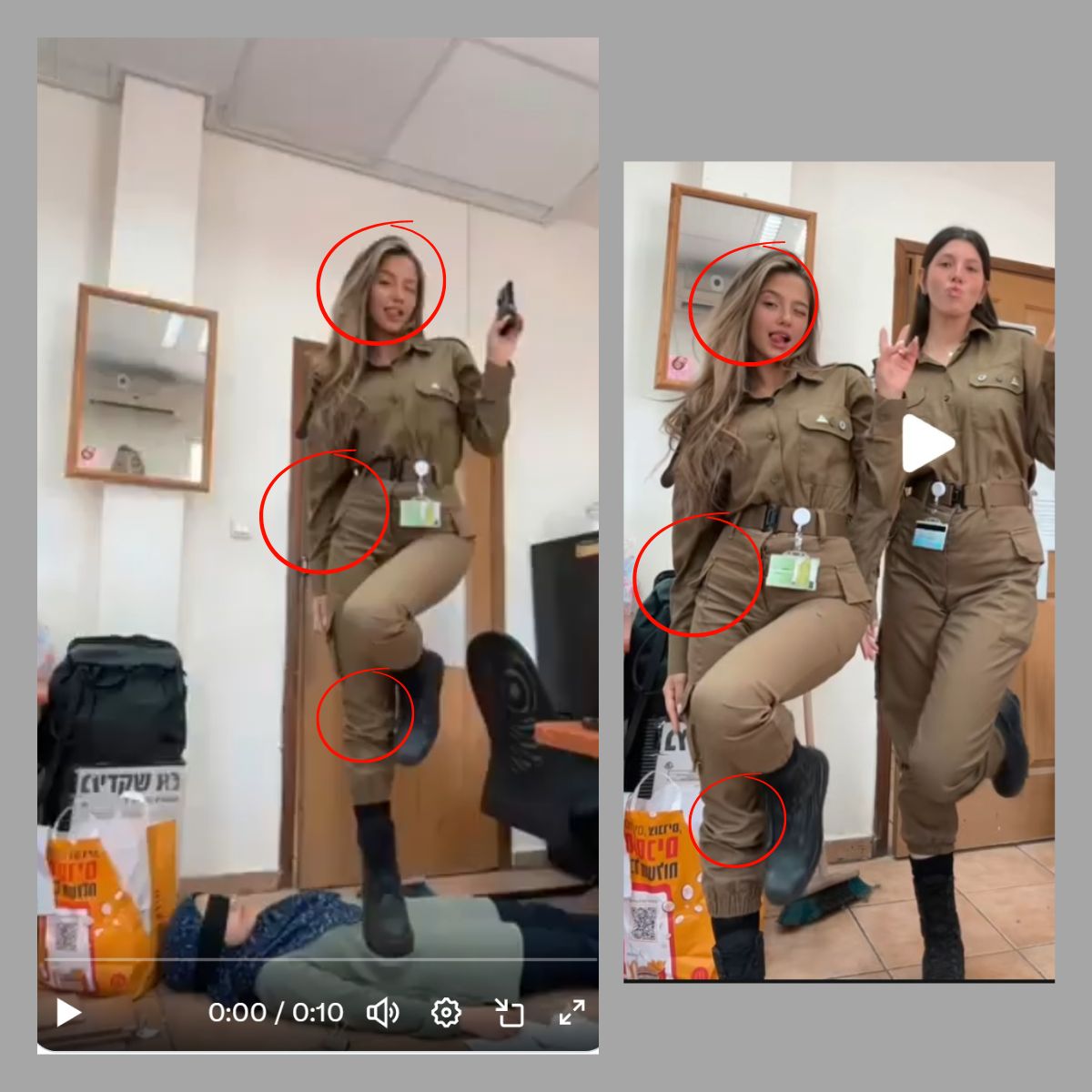

L’intelligenza artificiale ha utilizzato i lineamenti e i vestiti della soldatessa per rigenerare una scena completamente diversa, sovrapponendo la figura della donna palestinese a terra. Da notare come entrambi i primi fotogrammi mostrino la sondatessa nella stessa posa e con le stesse pieghe nella divisa, così come la capigliatura.

Le “allucinazioni” della generazione del falso video

Nonostante l’apparente realismo, l’IA di Google ha commesso diversi errori strutturali, le cosiddette “allucinazioni”.

Partiamo dallo specchio a sinistra. Nel riflesso si vede un condizionatore appeso al muro, ma nel video originale del 2023 sono presenti diversi elementi strutturali accanto all’apparecchio che, nel video generato da Gemini, scompaiono del tutto.

Nel video falso la porta appare completamente liscia, priva dei pannelli decorativi presenti nell’originale. Anche le scritte sulle borse e le scatole in basso a sinistra sono state alterate. Infatti, l’IA ha tentato di replicare gli strappi e i caratteri in ebraico, ma il risultato non è identico alla realtà. Non è tutto, come possiamo notare dal seguente confronto.

In un fotogramma appare a destra una sedia che è stata generata solo parzialmente dall’AI, risultando troncata rispetto all’originale.

Il trucco per nascondere le tracce di Gemini

Sottoponendo il video al controllo di SynthID, non viene riscontrata la firma digitale che Google inserisce nei contenuti generati dalla sua IA. C’è un motivo, o meglio dire un trucco. Quello che circola sui social non è il file digitale originale, ma la ripresa di uno schermo.

Attraverso il continuo movimento della telecamera che filma il monitor, l’autore che ha diffuso la fake news è riuscito a rendere il watermark irriconoscibile. Tuttavia, in un passaggio della ripresa, il logo di Gemini è visibile in basso a destra per alcuni istanti prima di scomparire a causa dell’inquadratura mossa.

Conclusioni

Siamo di fronte a un caso di propaganda costruita a tavolino. Utilizzando un video preesistente di un balletto social, l’Intelligenza Artificiale ha trasformato un momento ludico in un presunto crimine di guerra. Oltre al logo in basso a destra di Gemini, le incongruenze fisiche e architettoniche confermano la presenza dell’allucinazione AI.

Questo articolo contribuisce a un progetto di Meta per combattere le notizie false e la disinformazione nelle sue piattaforme social. Leggi qui per maggiori informazioni sulla nostra partnership con Meta.